Blog

Hướng dẫn cách cài đặt Ollama để chạy mô hình AI cục bộ trên Windows 11

Chạy các mô hình AI cục bộ trên Windows 11 với sự trợ giúp của Ollama, một công cụ mã nguồn mở phổ biến để cài đặt và quản lý các LLM mà không cần phụ thuộc vào đám mây.

Cập nhật 21/08/2025: Trên Windows 11, bạn có thể cài đặt Ollama để tải xuống và chạy nhiều mô hình AI cục bộ trên máy tính của mình, và trong hướng dẫn này, tôi sẽ trình bày các bước để hoàn thành việc này.

Mặc dù Windows 11 đi kèm với nhiều mô hình AI tích hợp cho các phần cứng cụ thể, chẳng hạn như Copilot+ PCs, nhưng chúng thường là các mô hình nhỏ và chuyên biệt. Do đó, cách chính để giao tiếp với các Mô hình ngôn ngữ lớn (LLM) là thông qua các chatbot trực tuyến, chẳng hạn như Microsoft Copilot, OpenAI ChatGPT và Google Gemini, cùng nhiều công cụ khác.

Vấn đề khi sử dụng các LLM này là chúng xử lý tất cả các yêu cầu trên đám mây, điều mà không phải ai cũng muốn. Đây chính là lúc Ollama trở thành một công cụ có giá trị.

Ollama là một công cụ mã nguồn mở cho phép bạn chạy các Mô hình ngôn ngữ lớn trực tiếp trên máy tính chạy Windows 11, 10 hoặc các hệ điều hành được hỗ trợ khác, sử dụng giao diện dòng lệnh hoặc giao diện đồ họa. Nó được thiết kế để làm cho quá trình tải xuống, chạy và quản lý các mô hình AI trở nên đơn giản cho người dùng cá nhân, nhà phát triển và nhà nghiên cứu.

Trong hướng dẫn này, tôi sẽ trình bày các bước để thiết lập một trong những công cụ dễ nhất để chạy LLM cục bộ trên máy tính của bạn.

Xem thêm: Hướng dẫn cách cài đặt Duck.ai (DuckDuckGo) dưới dạng ứng dụng trên Windows 11, 10

1. Cài đặt Ollama trên Windows 11 để chạy mô hình AI cục bộ

Để cài đặt Ollama cục bộ trên Windows 11, bạn hãy làm theo các bước sau:

1. Mở Start trên Windows 11.

2. Tìm kiếm Command Prompt (hoặc Terminal), nhấp chuột phải vào kết quả trên cùng và chọn tùy chọn “Run as administrator” (Chạy với quyền quản trị viên).

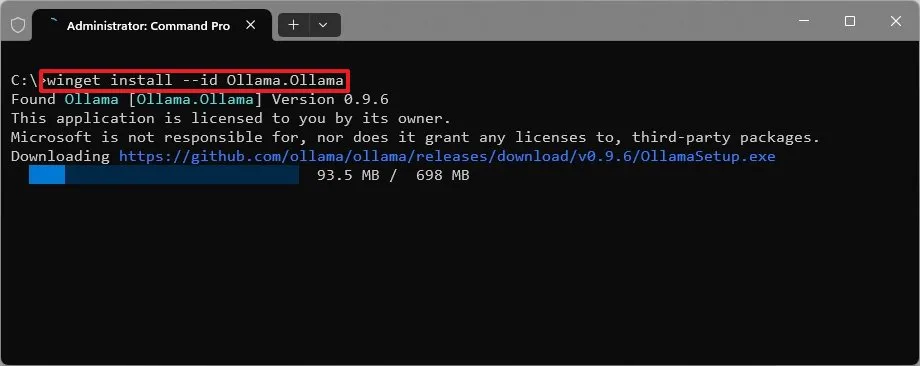

3. (Tùy chọn 1) Nhập lệnh sau để cài đặt công cụ Ollama chính thức và nhấn Enter:

winget install --id Ollama.Ollama

4. Nhấp vào nút “Finish” (Hoàn tất).

5. (Tùy chọn 2) Nhập lệnh sau để gỡ cài đặt Ollama khỏi Windows 11 và nhấn Enter:

winget uninstall--id Ollama.OllamaMẹo nhanh: Nên gỡ cài đặt bất kỳ mô hình AI nào khỏi máy tính trước khi gỡ Ollama.

Sau khi hoàn tất các bước, Ollama sẽ chạy ngầm và bạn có thể sử dụng giao diện dòng lệnh ollama để tương tác với nó từ Command Prompt hoặc PowerShell.

Ngoài việc sử dụng Windows Package Manager (winget) để cài đặt công cụ này, bạn luôn có thể tải trình cài đặt Ollama từ trang chính thức hoặc trang GitHub của nó.

2. Cài đặt và chạy AI LLM với Ollama trên Windows 11

Trước khi đi sâu vào việc cài đặt, hãy mở trang thư viện Ollama để quyết định mô hình AI nào bạn muốn cài đặt.

Trên trang, bạn sẽ tìm thấy danh sách các mô hình có sẵn từ DeepSeek, Google (gemma), Meta (llama) và các nhà cung cấp khác.

Bạn cũng sẽ thấy rằng mỗi mô hình có các ký hiệu như 1b, 4b, 12b, v.v., cho biết số lượng tham số tính bằng tỷ. Số lượng tham số càng cao thì mô hình càng lớn và có khả năng mạnh hơn. Tuy nhiên, chúng cũng sẽ yêu cầu phần cứng mạnh hơn.

Nếu bạn mới bắt đầu, bạn nên tải xuống phiên bản nhỏ nhất (ví dụ: “1b”) có sẵn.

Để cài đặt một mô hình AI bằng Ollama trên Windows 11, bạn hãy làm theo các bước sau:

1. Mở Start.

2. Tìm kiếm Command Prompt (hoặc Terminal), nhấp chuột phải vào kết quả trên cùng và chọn tùy chọn “Run as administrator” (Chạy với quyền quản trị viên).

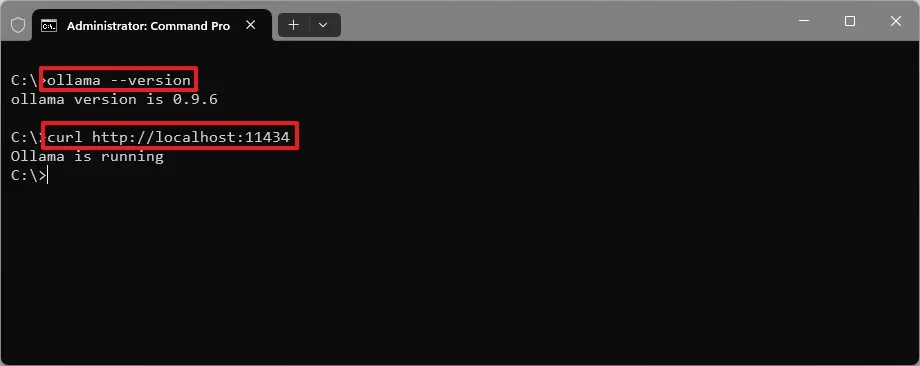

3. (Tùy chọn) Nhập lệnh sau để kiểm tra phiên bản Ollama và nhấn Enter:

ollama --version

4. (Tùy chọn) Nhập lệnh sau để xác nhận rằng Ollama đang chạy và nhấn Enter:

curl http://localhost:114345. (Tùy chọn 1) Nhập lệnh sau để cài đặt và chạy mô hình AI cục bộ trên máy tính của bạn và nhấn Enter:

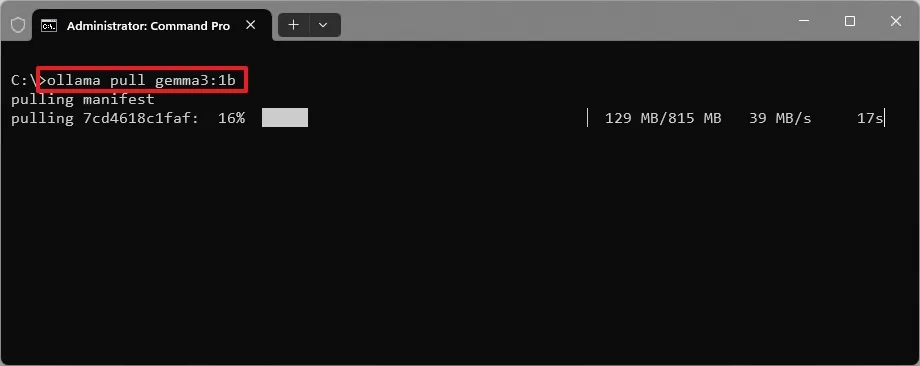

ollama pull gemma3:1b

Lưu ý nhanh: Lệnh này tải xuống phiên bản Google Gemma 3, bao gồm một tỷ tham số. Trong lệnh của bạn, hãy cập nhật gemma3:1b thành tên và phiên bản mô hình bạn muốn cài đặt, chẳng hạn như deepseek-r1:1.5b.

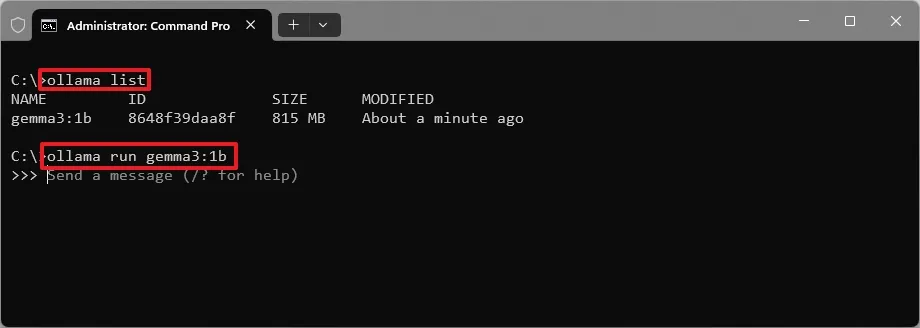

6. (Tùy chọn) Nhập lệnh sau để xem các mô hình đã cài đặt và nhấn Enter:

ollama list7. (Tùy chọn 2) Nhập lệnh sau để gỡ cài đặt một mô hình AI khỏi máy tính của bạn và nhấn Enter:

ollama rm gemma3:1b8. Nhập lệnh sau để xác nhận rằng mô hình không còn trên máy tính của bạn nữa và nhấn Enter:

ollama list9. Nhập lệnh sau để chạy một mô hình AI đã cài đặt bằng Ollama và nhấn Enter:

ollama run gemma3:1b

10. Trong lệnh, hãy xác nhận mô hình bạn muốn bắt đầu sử dụng với Ollama.

11. (Tùy chọn) Nhập lệnh sau để hiển thị tất cả các tiến trình đang chạy của Ollama và nhấn Enter:

ollama ps

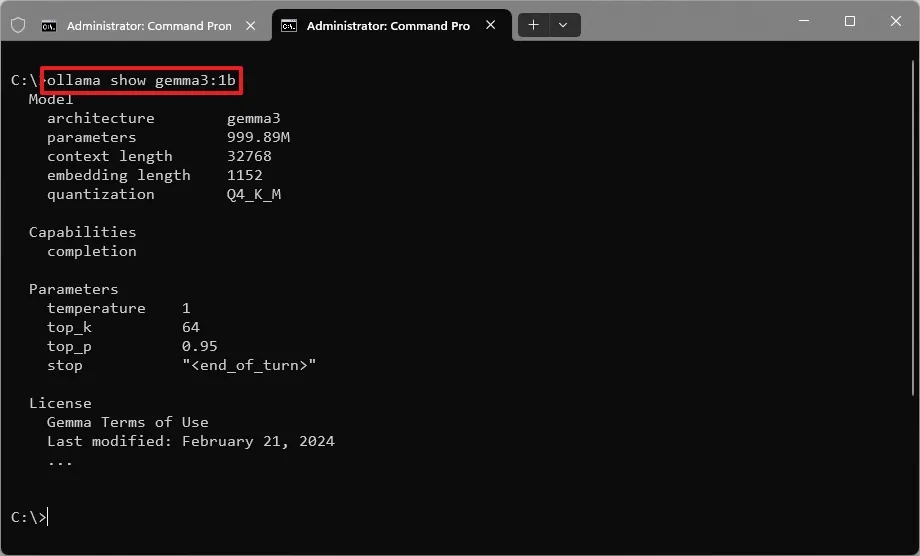

12. (Tùy chọn) Nhập lệnh sau để hiển thị chi tiết của một mô hình cụ thể, chẳng hạn như cấu hình và tham số, và nhấn Enter:

ollama show gemma3:1b13. Trong lệnh, hãy xác nhận mô hình bạn muốn bắt đầu sử dụng với Ollama.

Sau khi hoàn tất các bước, bạn có thể bắt đầu sử dụng LLM thông qua giao diện dòng lệnh.

Bạn cũng có thể sử dụng lệnh ollama –help để xem các lệnh có sẵn khác và lệnh ollama run –help để liệt kê các lệnh có sẵn cho một mô hình cụ thể.

3. Cách cài đặt và chạy AI LLM với Ollama trên Windows 11 (phương pháp GUI)

Để cài đặt một mô hình AI bằng ứng dụng Ollama GUI trên Windows 11, bạn hãy làm theo các bước sau:

1. Mở ứng dụng Ollama từ menu Start nếu nó không tự động khởi chạy sau khi cài đặt.

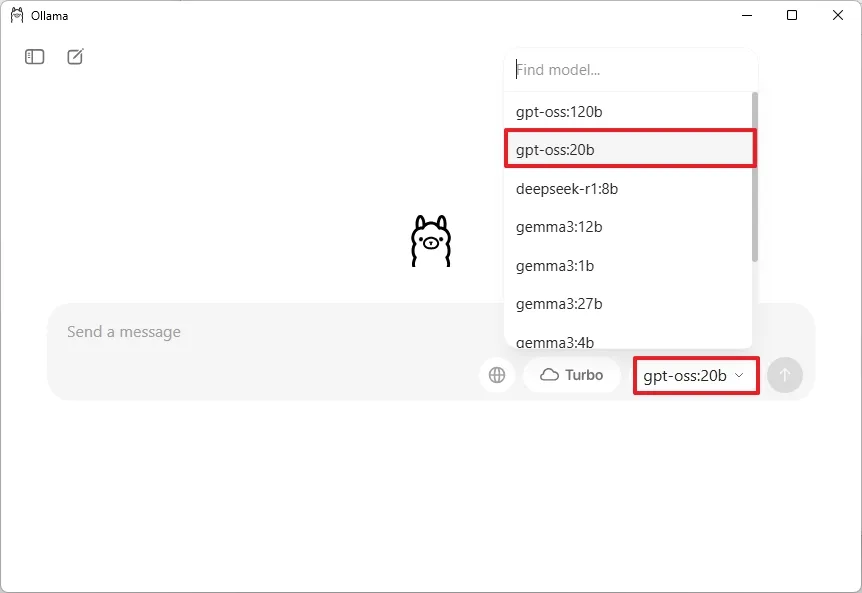

2. Nhấp vào menu mô hình AI và chọn mô hình để tải xuống. Ví dụ, tùy chọn “GPT-OSS:20b”.

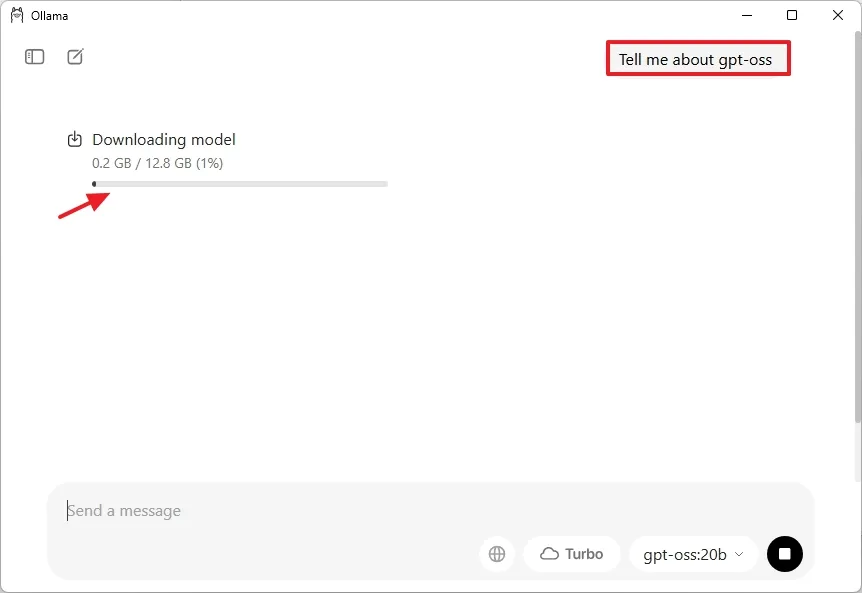

3. Soạn và gửi một câu hỏi để bắt đầu tải xuống mô hình OpenAI GPT.

Sau khi hoàn tất các bước, mô hình AI sẽ được tải xuống máy tính của bạn thông qua giao diện người dùng đồ họa.

Nếu bạn có tài khoản Ollama, bạn có thể đăng nhập để sử dụng tính năng tìm kiếm web tích hợp nhằm kết hợp khả năng của mô hình với thông tin mới nhất có sẵn trực tuyến.

Tùy chọn Turbo là một dịch vụ dựa trên đám mây của Ollama để chạy các mô hình AI lớn bằng cách sử dụng phần cứng cấp trung tâm dữ liệu. Nó được thiết kế để cung cấp hiệu suất và tốc độ cao cho các mô hình có thể quá lớn hoặc quá chậm để chạy trên máy tính cục bộ. Gói đăng ký hàng tháng có giá 20 đô la.

Ứng dụng Ollama không cung cấp tùy chọn tải trước các mô hình AI có sẵn. Tuy nhiên, bạn có thể hoàn thành việc này từ công cụ dòng lệnh như đã nêu ở trên.

4. FAQ về Ollama trên Windows 11

Nếu bạn vẫn còn thắc mắc về Ollama, những câu hỏi thường gặp sau đây sẽ giúp bạn làm rõ các khía cạnh khác nhau của công cụ này. Bạn luôn có thể đăng câu hỏi của mình trong phần bình luận bên dưới.

1. Có cần phần cứng AI chuyên dụng để chạy Ollama không?

Không, bạn có thể chạy các mô hình AI cơ bản mà bạn tải xuống bằng Ollama trên phần cứng tương đối hiện đại và bạn không nhất thiết phải có Bộ xử lý thần kinh (NPU). Ollama cũng có thể chạy trực tiếp trên bộ xử lý, nhưng rất nên có một card đồ họa.

Tuy nhiên, bạn sẽ cần phần cứng cụ thể để chạy các mô hình AI khác nhau tùy thuộc vào tham số của chúng. Ví dụ: bạn có thể chạy mô hình gpt-oss-20b với phần cứng hiện đại thông thường, nhưng nếu bạn muốn sử dụng mô hình gpt-oss-120b, bạn sẽ cần phần cứng rất mạnh, chẳng hạn như GPU NVIDIA với ít nhất 80GB VRAM, bộ xử lý cấp máy chủ (ví dụ: AMD EPYC hoặc Intel Xeon), ít nhất 256GB bộ nhớ và SSD NVMe tốc độ cao với ít nhất 500GB dung lượng trống cho trọng số mô hình và các tệp tạm thời.

2. Yêu cầu hệ thống để cài đặt Ollama trên Windows 11 là gì?

Yêu cầu hệ thống để cài đặt Ollama trên Windows 11 hoặc 10 là vừa phải:

- Bộ xử lý: Intel hoặc AMD x86-64.

- Bộ nhớ: 8GB, nhưng 16GB trở lên được khuyến nghị.

- Lưu trữ: 10GB dung lượng trống.

- Đồ họa: GPU tích hợp hoặc rời.

Mặc dù các yêu cầu không quá cao, tôi khuyên bạn nên sử dụng bộ xử lý đa lõi hiện đại, ít nhất 32GB RAM, hơn 256GB dung lượng trống trên SSD (ưu tiên NVMe) và card đồ họa như dòng RTX 30xx của Nvidia. Tuy nhiên, bạn luôn có thể sử dụng GPU AMD Radeon tương đương.

Ngoài ra, đối với các mô hình nâng cao, 4GB VRAM là mức tối thiểu được khuyến nghị.

Mô hình càng lớn thì càng yêu cầu nhiều tài nguyên, nghĩa là máy tính sẽ cần phần cứng mạnh mẽ hơn.

3. Ollama có sử dụng ảo hóa để chạy trên Windows 11 không?

Không, Ollama không tự tạo máy ảo. Tuy nhiên, nó tạo ra một môi trường biệt lập trên hệ thống để chạy các LLM. Môi trường này bao gồm tất cả các thành phần cần thiết, chẳng hạn như trọng số mô hình (dữ liệu được đào tạo trước) và các tệp cấu hình.

Điều quan trọng cần lưu ý là Ollama không còn yêu cầu WSL2 nữa. Nó chạy nguyên bản trên phiên bản Windows 11 hoặc 10 mới nhất.

Cập nhật ngày 21 tháng 8 năm 2025: Hướng dẫn này đã được cập nhật để đảm bảo tính chính xác và phản ánh những thay đổi trong quy trình.

5. Kết luận

Cài đặt Ollama để chạy mô hình AI cục bộ trên Windows 11 là một bước tiến tuyệt vời để khai thác sức mạnh của trí tuệ nhân tạo ngay trên máy tính cá nhân của bạn. Với các bước hướng dẫn chi tiết trong bài viết, bạn có thể dễ dàng thiết lập môi trường AI mạnh mẽ, tiết kiệm chi phí và đảm bảo quyền riêng tư dữ liệu. Việc sử dụng Ollama không chỉ giúp bạn khám phá tiềm năng của AI mà còn mang lại sự linh hoạt và kiểm soát tối ưu trong các dự án công nghệ.

Xem thêm: Hướng dẫn cách thay đổi cài đặt chế độ Sleep trên Windows 11

Nếu bạn cần thêm tài nguyên, phần cứng mạnh mẽ hoặc hỗ trợ kỹ thuật chuyên sâu để tối ưu hóa trải nghiệm AI, hãy ghé thăm COHOTECH – cửa hàng chuyên cung cấp các sản phẩm và dịch vụ công nghệ tiên tiến, luôn đồng hành cùng bạn trong hành trình khám phá công nghệ. Hãy để lại bình luận bên dưới để chia sẻ kinh nghiệm sử dụng Ollama hoặc đặt câu hỏi nếu bạn cần thêm thông tin. Đừng quên chia sẻ bài viết này với bạn bè và cộng đồng để cùng nhau trải nghiệm sức mạnh của AI cục bộ! Cảm ơn bạn đã đọc và ủng hộ!